在當今數據驅動的世界中,數據湖作為一種靈活且可擴展的數據存儲和處理解決方案,日益受到企業的青睞。與數據倉庫相比,數據湖能夠存儲結構化和非結構化數據,支持多種數據源和處理方式,為大數據分析和機器學習等應用提供了堅實的基礎。本文將詳細介紹數據湖的概念、優勢、挑戰,以及系統化的搭建方法論,涵蓋數據處理和存儲服務的關鍵環節。

什么是數據湖?

數據湖是一種集中式的存儲庫,用于存儲原始格式的海量數據,包括結構化數據(如數據庫表)、半結構化數據(如JSON、XML文件)和非結構化數據(如圖像、視頻、日志文件)。其核心思想是“先存儲,后處理”,允許用戶根據需要靈活地訪問和分析數據,無需預先定義模式。數據湖與數據倉庫的主要區別在于:數據倉庫通常存儲經過清洗和轉換的、用于商業智能的結構化數據,而數據湖則保留數據的原始形式,支持更廣泛的分析場景。

數據湖的優勢與挑戰

優勢:

- 靈活性高:數據湖支持多種數據格式和來源,無需預先建模,便于快速集成新數據。

- 成本效益:使用低成本存儲解決方案(如云對象存儲)可以降低總體擁有成本。

- 支持高級分析:結合大數據處理工具(如Apache Spark、Hadoop),數據湖能夠支持機器學習、實時分析和數據探索。

- 可擴展性強:云平臺上的數據湖可以按需擴展,應對數據量的快速增長。

挑戰:

- 數據治理困難:由于數據以原始形式存儲,可能缺乏元數據管理,導致“數據沼澤”問題。

- 安全和合規風險:集中存儲大量敏感數據需要嚴格的訪問控制、加密和合規措施。

- 性能優化:不當的數據分區和查詢策略可能導致處理效率低下。

數據湖的搭建方法論

搭建數據湖是一個系統性工程,涉及數據采集、存儲、處理、安全和管理等多個環節。以下是關鍵步驟和方法論:

- 需求分析與規劃

- 明確業務目標:確定數據湖將支持的應用場景,如數據分析、機器學習或實時報表。

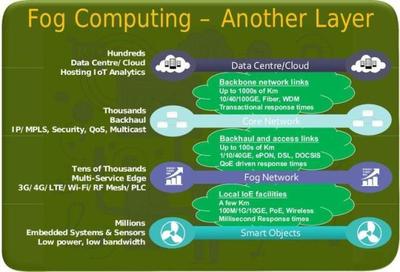

- 評估數據源:識別內部和外部數據來源,包括數據庫、IoT設備、社交媒體等。

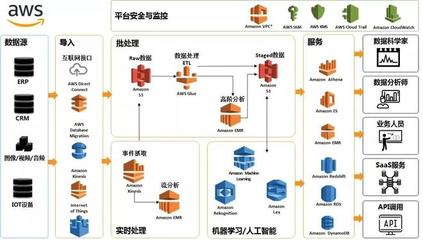

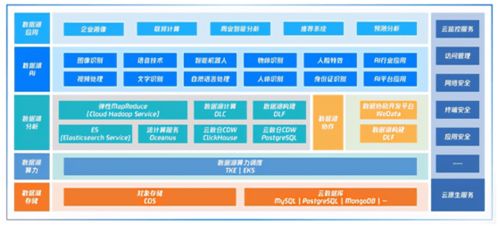

- 制定架構藍圖:選擇云平臺(如AWS、Azure、Google Cloud)或本地解決方案,設計存儲、計算和網絡基礎設施。

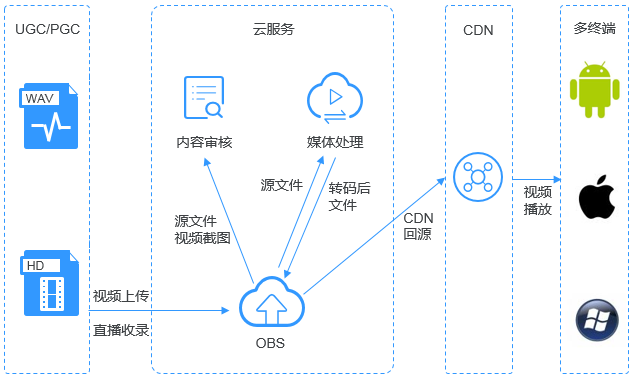

- 數據采集與注入

- 使用ETL/ELT工具:通過Apache NiFi、AWS Glue或自定義腳本,從源系統提取數據并加載到數據湖中。

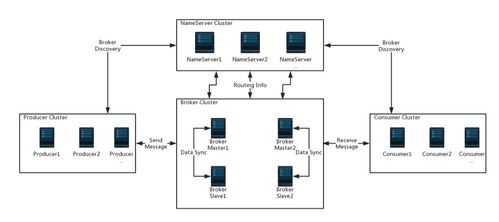

- 支持實時和批量處理:結合Kafka等流處理工具,實現實時數據流注入。

- 確保數據質量:在注入階段實施基本的數據驗證和去重。

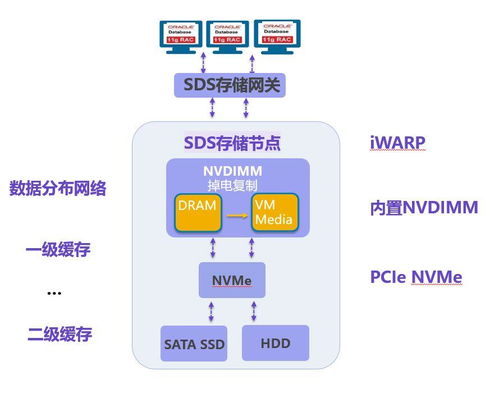

- 存儲服務設計

- 選擇存儲層:采用對象存儲(如Amazon S3、Azure Blob Storage)作為核心,提供高可用性和可擴展性。

- 組織數據目錄:使用分區和桶結構優化數據組織,便于查詢和管理。例如,按日期、業務域分區。

- 實現元數據管理:集成元數據目錄工具(如AWS Glue Data Catalog或Apache Atlas),記錄數據來源、格式和訪問權限。

- 數據處理與轉換

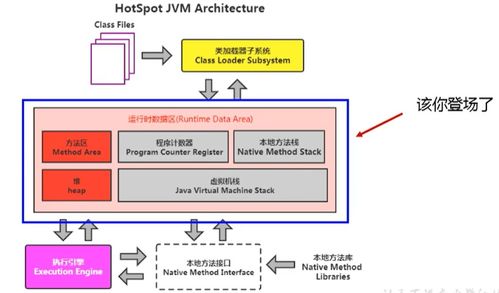

- 構建數據處理管道:利用Apache Spark、Flink或云服務(如AWS Lambda)進行數據清洗、轉換和聚合。

- 支持多種處理模式:包括批處理(用于歷史數據分析)和流處理(用于實時應用)。

- 優化性能:通過數據壓縮、列式存儲(如Parquet、ORC格式)和索引提升查詢效率。

- 數據安全與治理

- 實施訪問控制:使用IAM角色、加密(如SSL/TLS、AES-256)和審計日志,確保數據安全。

- 建立數據治理框架:定義數據血緣、數據質量規則和合規策略,防止數據沼澤。

- 監控與維護:部署監控工具(如CloudWatch、Prometheus)跟蹤數據湖性能,并及時處理問題。

- 集成與分析服務

- 連接分析工具:集成BI工具(如Tableau、Power BI)和機器學習平臺(如AWS SageMaker),支持數據消費。

- 提供API接口:通過REST API或GraphQL,允許應用程序直接訪問數據湖中的數據。

實際應用案例

以一家電商公司為例,他們使用AWS S3構建數據湖,收集用戶行為數據、交易記錄和社交媒體反饋。通過AWS Glue進行ETL處理,將數據轉換為Parquet格式,并使用Athena進行查詢分析。同時,結合機器學習模型預測用戶偏好,提升了推薦系統的準確性。這種方法不僅降低了存儲成本,還加速了數據洞察的生成。

總結

數據湖作為現代數據處理架構的核心組件,為企業提供了處理海量多樣化數據的能力。成功搭建數據湖需要綜合考慮存儲、處理、安全和治理等方面。通過采用云原生服務和開源工具,企業可以構建高效、可擴展的數據湖,支撐數據驅動的決策和創新。未來,隨著人工智能和邊緣計算的發展,數據湖將進一步演進,集成更多智能化和實時化功能,成為數字化轉型的關鍵基石。

通過本文的詳解,讀者可以全面理解數據湖的概念、搭建方法論及其在數據處理和存儲服務中的應用,為實際項目提供指導。